Migliore prestazione ed espressione emotiva.

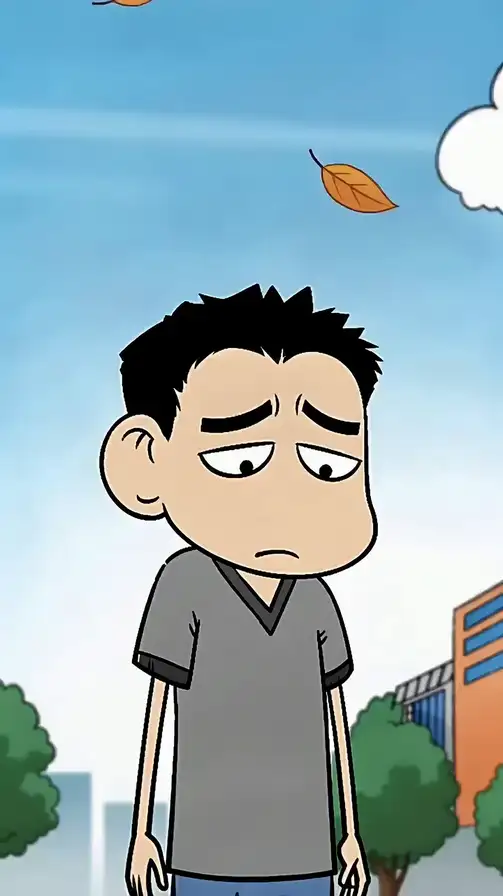

I personaggi di AI spesso sembrano piatti o finti: le emozioni non arrivano. Seedance 2.0 migliora le microespressioni e il linguaggio del corpo in modo che i personaggi possano mostrare gioia, tristezza, sorpresa o rabbia in un modo più naturale; occhi, bocca e gesti si leggono meglio. Se vuoi personaggi AI con una vera "recitazione", 2.0 ti porta lì.

Le prestazioni emotive sono migliorate per una resa dei personaggi più espressiva e sfumata.

Come funziona: il modello genera personaggi le cui micro-espressioni facciali (movimento degli occhi, forma della bocca, posizione delle sopracciglia) e linguaggio del corpo (gesti, postura, intensità del movimento) rispondono al contesto emotivo descritto nel prompt. Invece di volti piatti e neutri, i personaggi possono esprimere gioia, tristezza, sorpresa, rabbia o stati più sottili come esitazione o curiosità.

Quando usarlo: contenuti per virtual human e VTuber dove la connessione emotiva guida il coinvolgimento del pubblico; narrazione di brand dove l'emozione del personaggio porta avanti la storia; contenuti educativi dove un personaggio istruttore deve apparire caloroso e accessibile; shorts per social media dove personaggi espressivi aumentano il tempo di visualizzazione e le condivisioni.

Suggerimenti pratici: sii specifico sull'emozione e la sua intensità nel prompt — 'sorriso gentile con un leggero movimento della testa' produce risultati più sfumati di un semplice 'felice'. Per scene di dialogo, abbina l'espressione emotiva all'audio nativo per ottenere tono vocale e espressione facciale sincronizzati. Il modello gestisce transizioni tra emozioni all'interno di una singola inquadratura (es. 'inizia sorpreso poi scoppia a ridere'), utile per contenuti narrativi brevi. Combina con la coerenza dei personaggi per assicurarti che lo stesso personaggio mantenga la propria identità mentre esprime emozioni diverse tra le inquadrature.

Esempio illustrativo

Agenzia per idoli virtualiUmano virtuale/VTuber

AI Streaming live emozionale umano virtuale

Contesto

Gli avatar virtuali tradizionali hanno espressioni rigide ed emozioni monotone, che rendono difficile stabilire connessioni emotive con gli spettatori; il tasso di fidelizzazione dell'interazione è basso

Come è stato utilizzato

Sono stati utilizzati i controlli dell'espressione delle emozioni in modo che AI gli esseri umani virtuali potessero mostrare espressioni e linguaggio del corpo più ricchi durante i contenuti live.

Dati di riferimento

I dati di riferimento citati per questo esempio includono l'aumento dell'interazione live streaming del 180%, il tempo medio di visualizzazione triplicato, il numero di follower superiore a 1 milione e le entrate derivanti dalle sponsorizzazioni in crescita di 5 volte.

✦Perché è importante:I controlli della microespressione e del linguaggio del corpo hanno reso le performance più facili da leggere.

Fonte

I casi illustrativi su questo sito sono compilati da riepilogo delle campagne pubbliche e report secondari disponibili al momento della scrittura.

Contesto temporale

I Metrics riflettono il periodo di campagna segnalato e non devono essere trattati come benchmark di performance attuali.

Nota informativa

I nomi e le cifre di marca sono citati solo per uso esplicativo, non come approvazioni, garanzie o risultati verificati indipendentemente.