Mejor rendimiento y expresión emocional.

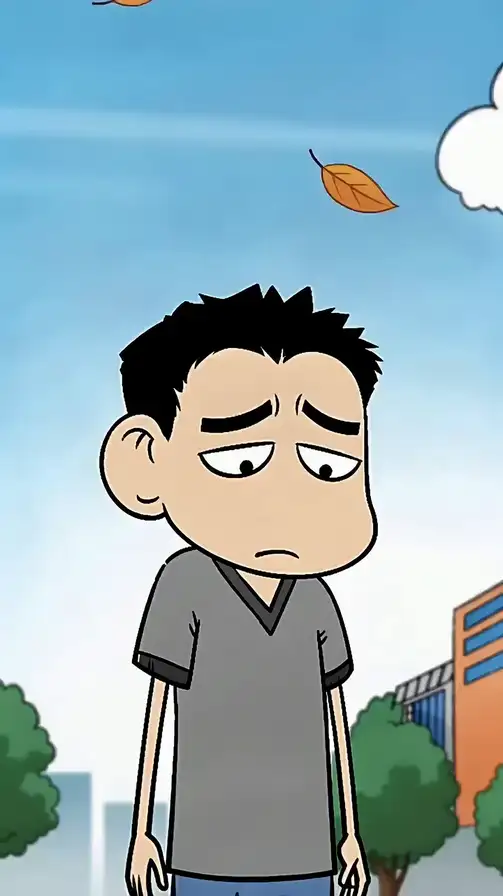

Los personajes de AI a menudo parecen planos o falsos: las emociones no llegan. Seedance 2.0 mejora las microexpresiones y el lenguaje corporal para que los personajes puedan mostrar alegría, tristeza, sorpresa o enojo de una manera más natural; Los ojos, la boca y los gestos se leen mejor. Si quieres AI personajes con "actuación" real, 2.0 te lleva allí.

El rendimiento emocional se mejora para una entrega de personajes más expresiva y matizada.

Cómo funciona: el modelo genera personajes cuyas microexpresiones faciales (movimiento de ojos, forma de la boca, posición de las cejas) y lenguaje corporal (gestos, postura, intensidad del movimiento) responden al contexto emocional descrito en tu prompt. En lugar de rostros planos y neutrales, los personajes pueden expresar alegría, tristeza, sorpresa, enojo o estados más sutiles como vacilación o curiosidad.

Cuándo usarlo: contenido de humanos virtuales y VTuber donde la conexión emocional impulsa el engagement de la audiencia; narrativa de marca donde la emoción del personaje lleva la narrativa; contenido educativo donde un personaje instructor necesita parecer cálido y accesible; cortos de redes sociales donde personajes expresivos aumentan el tiempo de visualización y las comparticiones.

Consejos y notas prácticas: sé específico sobre la emoción y su intensidad en tu prompt — 'sonrisa suave con una ligera inclinación de cabeza' produce resultados más matizados que simplemente 'feliz'. Para escenas de diálogo, combina la expresión de emociones con audio nativo para obtener tono vocal y expresión facial sincronizados. El modelo maneja transiciones entre emociones dentro de una sola toma (por ejemplo, 'empieza sorprendido y luego rompe en risa'), lo cual es útil para contenido narrativo corto. Combina con consistencia de personajes para asegurar que el mismo personaje mantenga su identidad mientras expresa diferentes emociones entre tomas.

Ejemplo ilustrativo

Agencia de ídolos virtualesHumano virtual/VTuber

AI Transmisión virtual en vivo de emociones humanas

Contexto

Los avatares virtuales tradicionales tienen expresiones rígidas y emociones monótonas, lo que dificulta establecer conexiones emocionales con los espectadores; La tasa de retención de interacción es baja.

como se uso

Se utilizaron controles de expresión de emociones para que AI humanos virtuales pudieran mostrar expresiones y lenguaje corporal más ricos durante el contenido en vivo.

Datos de referencia

Las cifras de referencia citadas para este ejemplo incluyen un aumento de la interacción de transmisión en vivo del 180 %, el tiempo promedio de visualización se triplica, un número de seguidores superior al millón y un aumento de cinco veces en los ingresos por patrocinio.

✦Por qué es importante:Los controles de microexpresión y lenguaje corporal hicieron que las actuaciones fueran más fáciles de leer.

Base de origen

Los casos ilustrativos en este sitio se compilan a partir de resúmenes de campañas públicas e informes secundarios disponibles al momento de escribir este artículo.

Contexto temporal

Las métricas reflejan el período de la campaña informado y no deben tratarse como puntos de referencia de rendimiento actuales.

Nota de datos

Los nombres de marcas y las cifras se citan únicamente con fines explicativos, no como respaldos, garantías o resultados auditados de forma independiente.