Konsistente Charaktere und visueller Stil in allen Aufnahmen.

Bei Arbeiten mit mehreren Aufnahmen treten häufig Probleme auf, darunter das Abdriften der Charaktere zwischen den Aufnahmen, das Weichzeichnen von Produktdetails, die Unschärfe kleiner Texte oder das Verlieren eines einheitlichen Erscheinungsbilds bei Szenen. Diese Seite konzentriert sich auf die konsistenzbezogenen Kontrollen, die häufig verwendet werden, um diese Probleme zu reduzieren und Gesichter, Kleidung und feine Details stabiler zu halten.

Seedance 2.0 hält Charaktere und visuellen Stil über Einstellungen hinweg konsistent, damit Ihre Multi-Shot-Geschichten zusammenhängend bleiben.

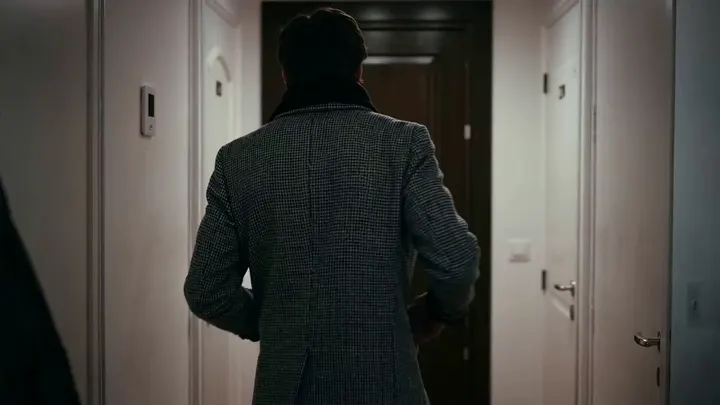

So funktioniert es: Laden Sie ein Referenzbild Ihres Charakters hoch. Das Modell analysiert Gesichtszüge, Kleidungsdetails und den gesamten visuellen Stil und wendet diese Vorgaben auf jede nachfolgende Generierung an. Das bedeutet, dass Haarfarbe, Kleidungsmuster und Gesichtsstruktur eines Charakters erhalten bleiben, selbst wenn sich Szene, Kamerawinkel oder Beleuchtung zwischen den Einstellungen ändern.

Wann Sie dies verwenden sollten: Multi-Shot-Werbekampagnen, bei denen ein Model in mehreren Szenen auftreten muss; Produktvideos, bei denen der Artikel über alle Winkel hinweg identisch aussehen muss; serialisierte Inhalte wie Kurzdramen oder episodische Markengeschichten; jedes Projekt, bei dem visuelle Kontinuität über Einstellungen hinweg wichtiger ist als einmalige kreative Abwechslung.

Tipps und praktische Hinweise: Stellen Sie die Referenzstärke zwischen 70–80 % ein, um natürlich wirkende Ergebnisse zu erzielen, die dennoch leichte szenengerechte Variation zulassen. Halten Sie Beleuchtungsbeschreibungen über alle Prompts hinweg konsistent. Für Produktaufnahmen exportieren Sie das höchstauflösende Referenzbild, das Sie haben — feine Details wie Text auf Verpackungen oder Nähte lassen sich aus einer scharfen Vorlage leichter beibehalten. Wenn Sie nach mehreren Generierungen ein Abdriften bemerken, verankern Sie neu, indem Sie das Originalreferenzbild statt eines generierten Frames verwenden.

Anschauliches Beispiel

SHEINGrenzüberschreitender E-Commerce

AI Produktvideo-Konsistenzlösung

Kontext

Wird benötigt, um Referenzvideos für mehr als 3000 Produkte zu erstellen; Herkömmliche Dreharbeiten waren kostspielig und es war schwierig, ein einheitliches Erscheinungsbild des Modells aufrechtzuerhalten

Wie es verwendet wurde

Verwendete Technologie zur Zeichenkonsistenz, um Produktreferenzvideos über verschiedene Szenen hinweg auf der Grundlage eines einzelnen Modellreferenzbilds stapelweise zu generieren

Referenzdaten

Zu den für dieses Beispiel genannten Referenzzahlen zählen ein Rückgang der Videokosten pro Produkt von 10.000 CNY auf 500 CNY, ein Anstieg des wöchentlichen Einführungsvolumens von 1.000 auf 3.000 Artikel und eine 2,3-fache Steigerung für Produkte, die Video verwenden.

✦Warum es wichtig ist:Es wurde ein Referenzbildsystem verwendet, um das Erscheinungsbild des Modells über mehrere Szenen hinweg in größerem Maßstab konsistenter zu halten

Quellenbasis

Anschauliche Fälle auf dieser Website werden aus öffentlichen Kampagnenrückblicken und sekundären Berichten zusammengestellt, die zum Zeitpunkt des Schreibens verfügbar waren.

Zeitkontext

Die Kennzahlen spiegeln den gemeldeten Kampagnenzeitraum wider und sollten nicht als aktuelle Leistungsbenchmarks betrachtet werden.

Datennotiz

Markennamen und Zahlen werden nur zu Erläuterungszwecken zitiert, nicht als Empfehlungen, Garantien oder unabhängig geprüfte Ergebnisse.