Betere emotionele prestaties en expressie.

AI-personages zien er vaak vlak of nep uit; de emotie komt niet over. Seedance 2.0 verbetert micro-expressies en lichaamstaal, zodat personages op een meer natuurlijke manier vreugde, verdriet, verrassing of woede kunnen tonen; ogen, mond en gebaren lezen allemaal beter. Als je AI-personages met echt 'acteerwerk' wilt, kun je met 2.0 daar komen.

Emotionele prestaties zijn verbeterd voor expressievere en genuanceerdere karakterweergave.

Hoe het werkt: het model genereert personages waarvan de gezichts-micro-expressies (oogbeweging, mondvorm, wenkbrauwpositie) en lichaamstaal (gebaren, houding, bewegingsintensiteit) reageren op de emotionele context beschreven in je prompt. In plaats van vlakke, neutrale gezichten kunnen personages vreugde, verdriet, verrassing, woede of subtielere toestanden als aarzeling of nieuwsgierigheid uitdrukken.

Wanneer gebruiken: virtuele-mens- en VTuber-content waarbij emotionele connectie de betrokkenheid van het publiek drijft; merkverhalen waarbij de emotie van personages het verhaal draagt; educatieve content waarbij een instructeurspersonage warm en benaderbaar moet overkomen; social media shorts waarbij expressieve personages kijktijd en deelacties verhogen.

Tips en praktische opmerkingen: wees specifiek over de emotie en intensiteit in je prompt — 'zacht glimlachend met een licht gekanteld hoofd' levert genuanceerdere resultaten op dan alleen 'blij.' Combineer voor dialoogscènes emotie-expressie met native audio voor gesynchroniseerde stemtoon en gezichtsexpressie. Het model verwerkt overgangen tussen emoties binnen één shot (bijv. 'begint verrast en barst dan in lachen uit'), wat nuttig is voor korte verhalende content. Combineer met karakterconsistentie om ervoor te zorgen dat hetzelfde personage zijn identiteit behoudt terwijl het verschillende emoties uitdrukt over shots heen.

Illustratief voorbeeld

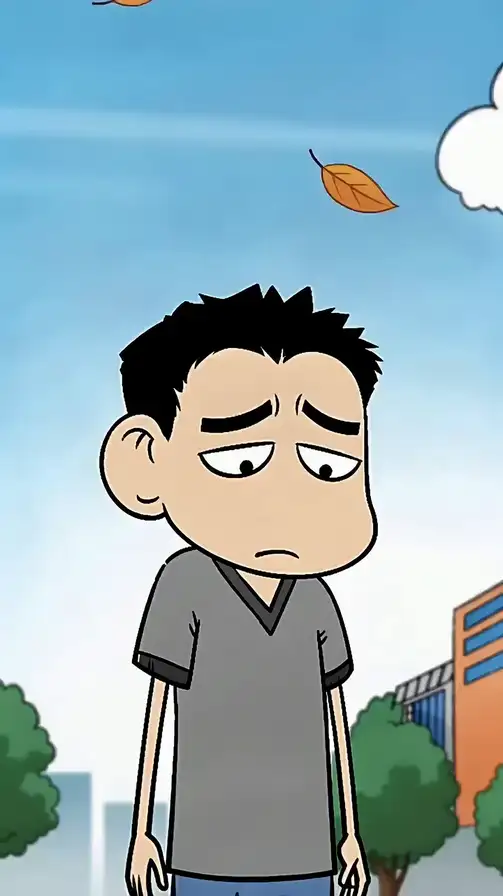

Virtueel IdoolbureauVirtuele mens/VTuber

AI Virtuele menselijke emotionele livestreaming

Context

Traditionele virtuele avatars hebben rigide uitdrukkingen en monotone emoties, waardoor het moeilijk is om emotionele banden met kijkers tot stand te brengen; Het retentiepercentage voor interacties is laag

Hoe het werd gebruikt

Gebruikte bedieningselementen voor emotie-expressie zodat AI virtuele mensen rijkere uitdrukkingen en lichaamstaal konden laten zien tijdens live inhoud.

Referentiegegevens

Referentiecijfers die voor dit voorbeeld worden genoemd, zijn onder meer een stijging van de livestream-interactie met 180%, een verdrievoudiging van de gemiddelde kijktijd, een aantal volgers van meer dan 1 miljoen en een vervijfvoudiging van de opbrengst uit sponsorcampagnes.

✦Waarom het ertoe doet:Micro-expressie en lichaamstaalcontroles maakten de uitvoeringen gemakkelijker leesbaar.

Bronbasis

Illustratieve gevallen op deze site zijn samengesteld uit publieke campagne samenvattingen en secundaire rapportage beschikbaar op het moment van schrijven.

Tijdcontext

Metrics weerspiegelen de gerapporteerde campagneperiode en mogen niet worden behandeld als huidige prestatiebenchmarks.

Gegevensnota

Merknamen en cijfers worden uitsluitend vermeld voor verklarend gebruik, niet als aanbevelingen, garanties of onafhankelijk gecontroleerde resultaten.